Agent 产品拆解—OpusClip:不是剪辑工具,而是你的 AI 剪辑总监

AI Agent 产品拆解 视频剪辑

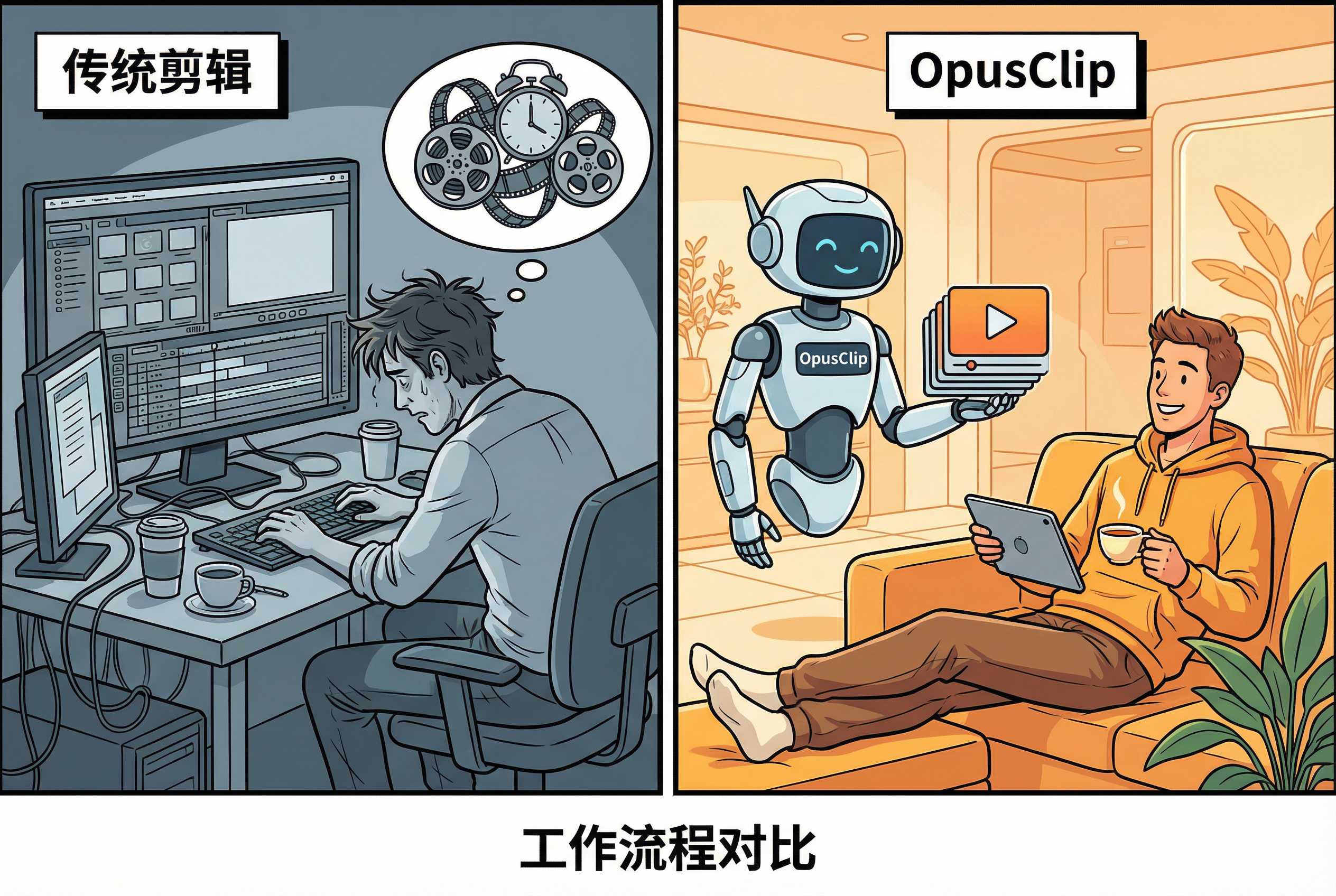

在 TikTok、抖音和 YouTube Shorts 统治注意力的时代,每一个播客主、长视频创作者都面临着同一个”炼狱”:手里拿着 1 小时的优质长视频,却需要耗费数小时去回看、挑选、剪辑、做字幕,才能产出几条能用的短视频。

传统的剪辑软件(如 Pr)是给专业人士用的”锤子”,你需要自己动手去砸、去雕琢。而 OpusClip 的出现,让视频工具从 “辅助操作”向”代理决策” 改变。它不给你锤子,它直接给你交付”盖好的房子”。

今天,我将深度拆解 OpusClip,看看视频长剪短的智能体(Agent),是如何重塑内容生产流的。

一、 场景定义:从”线性编辑”到”价值提取”

OpusClip 的核心定位非常精准:它不是用来”创造”视频的(那是 Sora 的事),它是用来 “挖掘” 视频的。它解决的核心矛盾,是长视频的信息密度与短视频的快节奏之间的矛盾。

我们可以通过对比”传统模式”与”智能体模式”来理解它的价值:

-

传统工具思维(给我一把锤子): 以前的剪辑软件把工具给你,你需要自己把 60 分钟的视频看完,自己挑精彩片段,自己把 16:9 的画面裁切成 9:16,还要自己手动上字幕。软件只是帮你操作,做决定的是你。

-

智能体代理思维(给我一个结果): OpusClip 的逻辑是 “决策外包”。它像是一个经验丰富的剪辑助理。你把长视频扔给它,它负责看完,凭”直觉”挑出最可能火的 10 个片段,并自动完成裁剪和包装。你不需要决定剪哪里,做决定的是 AI。

二、 解构 OpusClip:是如何像人一样工作的?

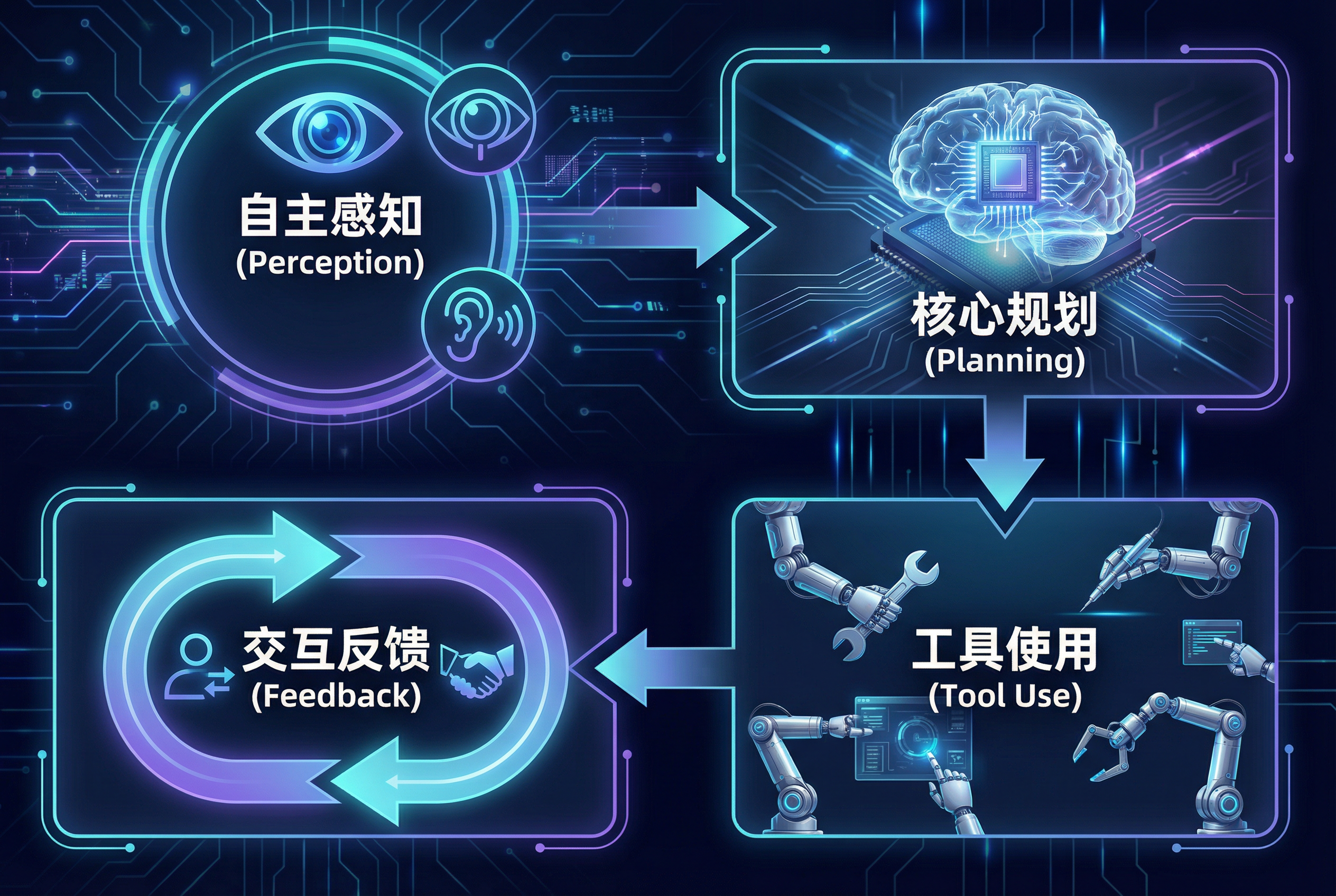

我们依据 AI Agent 的标准定义——“以大模型为大脑,具备自主感知、规划和工具使用能力,通过交互反馈交付确定性结果”——来拆解 OpusClip。

自主感知:它是怎么”感知”的?

Agent 的第一步是收集信息。OpusClip 的感知是 多模态 且 并行 的,它不只是”读”视频,而是真正在”看”和”听”。

-

听觉感知(语义理解): 它首先调用语音转文字模型,将视频音轨转录为逐字稿。但它不止是听写,还在进行语义分析:识别关键词、语气停顿、以及笑声。

-

视觉感知(空间理解): 这是它的独门绝技。它利用计算机视觉算法,实时进行 人脸检测 和 活跃说话人追踪。它能感知到画面中谁是主角,谁在说话,甚至感知到画面的构图重心。

核心规划:调用什么模型?怎么规划?

这是 Agent 的大脑。它不是简单地执行”每隔 30 秒切一段”,而是通过 大模型 + 专用评分模型 来进行复杂的决策规划。

-

调用模型: 它底层极有可能调用了 GPT-4 级别的通用大模型来理解长文本的上下文逻辑,同时配合自家训练的 “病毒传播评分模型”。

-

规划逻辑(思维链):

- 初筛: 扫描全文,根据语义连贯性,找出 20 个潜在的”完整话题片段”。

- 推理与打分: 结合评分模型,Agent 对这 20 个片段进行推理:“片段 A 讲的是废话(0分);片段 B 有情绪冲突且包含热词’AI 泡沫’(95分)”。

- 决策: 最终规划出”保留前 10 个高分片段”的剪辑方案,并确定每个片段的起止时间点。

工具使用:使用了哪些工具?

规划完成后,Agent 需要动用”手脚”来执行。OpusClip 封装了一套极其自动化的 后期工具链:

-

智能构图工具: 基于视觉感知的数据,它会调用裁剪工具,将横屏画面动态裁剪为竖屏,并根据人物移动轨迹自动生成关键帧,模拟摄像机运镜。

-

字幕引擎工具: 调用字幕生成器,不仅把字放上去,还根据语义自动给关键词加颜色高亮,甚至根据情绪自动插入 Emoji 表情。

-

空镜匹配工具: (最新能力) 当检测到画面长时间静止时,它会自动调用素材库接口,搜索并插入相关的空镜素材。

交互反馈:怎么交互?怎么反馈?

这是 Agent 从”概率”走向”确定性”的关键。OpusClip 通过环境(用户和市场)的反馈来闭环。

-

与用户的交互(人机协同): Agent 交付初稿后,并非”一锤子买卖”。它提供了一个可视化编辑器。如果用户手动修改了某个片段的”开始时间”,或者把某个 AI 选的关键词”去掉了高亮”。Agent 会接收这个 负反馈 信号,在后续的版本或其他用户的类似场景中,优化其判断逻辑。

-

与市场的交互(数据飞轮): OpusClip 的”病毒传播评分”并非静态。它会根据全网短视频的趋势(环境)不断更新权重,确保持续输出符合市场口味的内容。

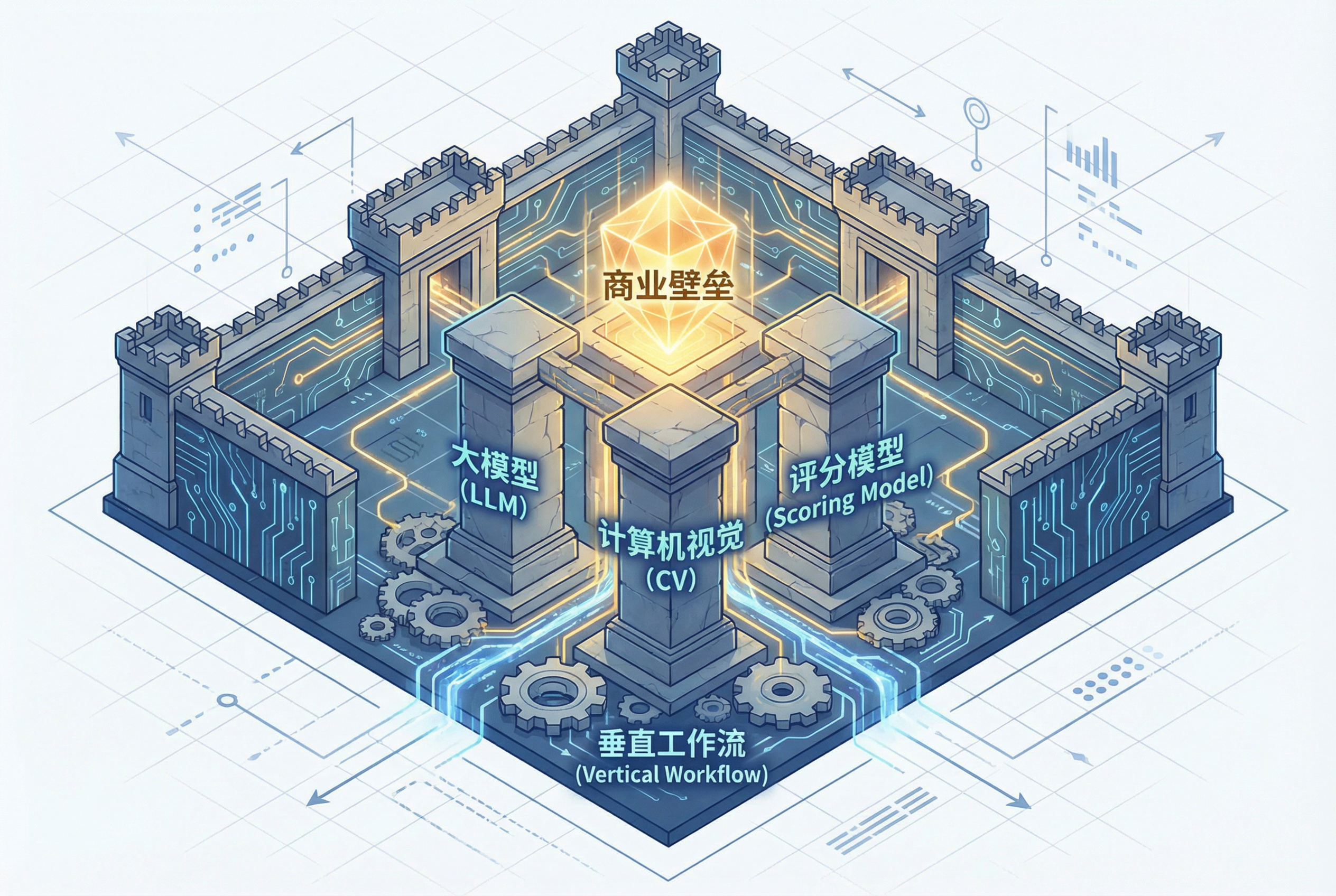

三、 商业壁垒:垂直工作流的胜利

OpusClip 的成功证明了:通用大模型无法解决所有问题,垂直工作流才是护城河。

如果只用 GPT-4,你只能得到文字摘要。如果只用视觉算法,你只能得到人脸追踪。OpusClip 的壁垒在于它将 大模型(理解内容)+ 计算机视觉(理解画面)+ 评分模型(理解市场) 完美地封装在一个”一键式”的工作流中。

这种 端到端 的体验,构建了极高的数据飞轮:用户剪辑得越多,它的评分模型就越精准,用户就越离不开。

四、 局限性与批判

尽管 OpusClip 表现出色,但在深度体验后,我发现了 Agent 目前的”天花板”:

-

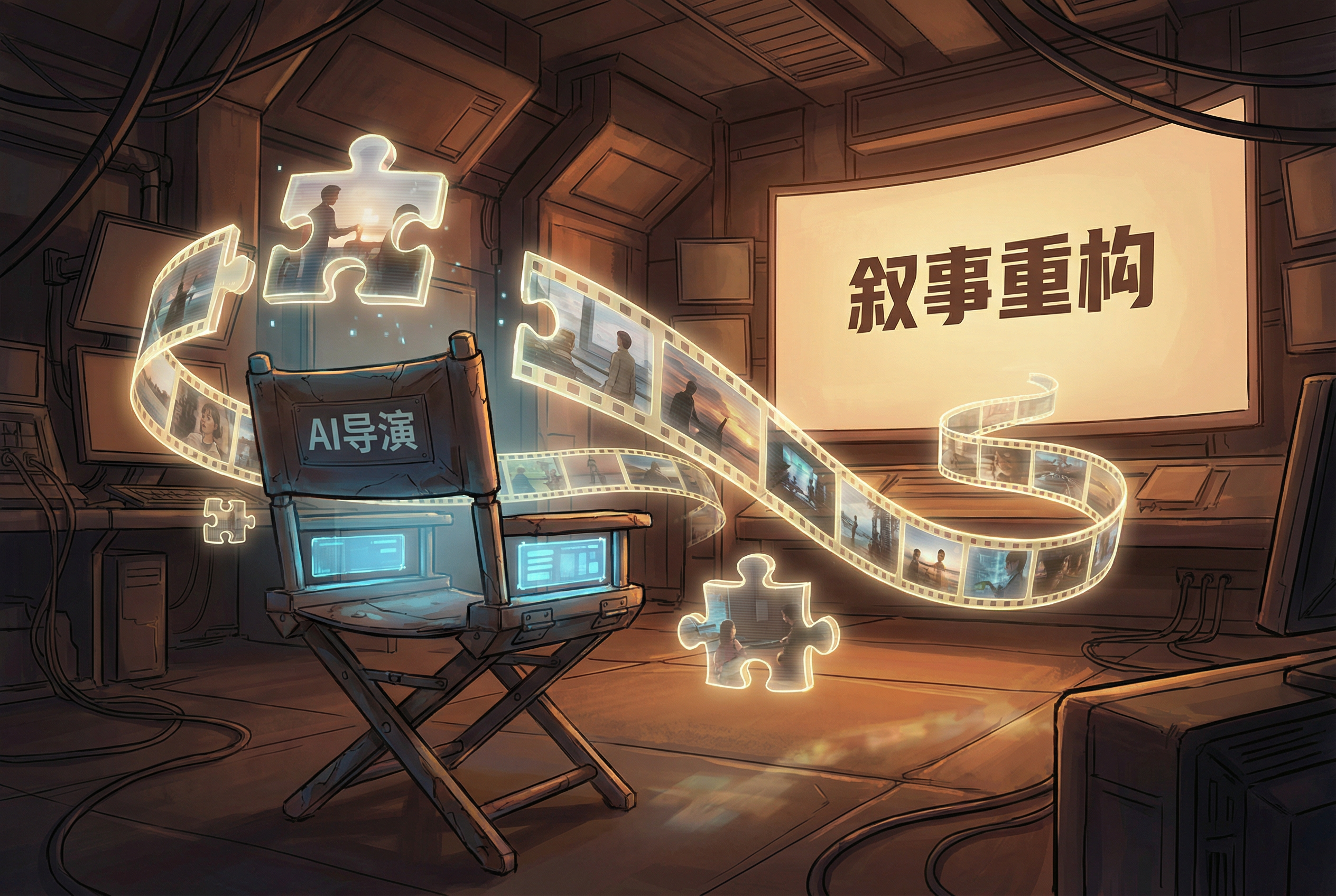

“叙事感”的缺失: AI 目前擅长提取”金句片段”,但不擅长 “叙事重组”。它很难将分散在视频开头和结尾的两个相关观点,剪辑到一起形成一个新的论点。它更像是一个”切片工”,而不是一个”导演”。

-

风格同质化: 生成的字幕和剪辑节奏非常”TikTok 风”。对于追求独特品牌调性的高端创作者来说,OpusClip 的”流水线味”太重了。

五、 个人思考:如果我是产品经理,下一步会做什么?

如果让我来规划 OpusClip 的下一个核心功能,我会将产品重心从”单点切割”升级为 “叙事重构”。

目前的 Agent 是 提取式 的。未来的 Agent 应该是 生成式剪辑:

-

功能设想: 用户输入一个指令:“帮我把这期播客中关于’AI 泡沫’的所有观点剪在一起,形成一个 3 分钟的辩论视频。”

-

Agent 动作: 扫描全文 -> 跨时间轴提取相关段落 -> 智能拼接 -> 甚至生成中间的过渡旁白。

这将使 OpusClip 从一个”短视频切片工具”,进化为一个真正的”长视频二次创作引擎”。

结语

OpusClip 是 AI Agent 在 “非结构化数据(视频)处理” 领域的标杆。它告诉我们:最好的 AI 产品,往往是那些让用户 “少做决定” 的产品。

在内容生产的赛道上,Agent 正在逐步接管那些重复、繁琐、但又需要一定审美的”中间环节”。对于创作者而言,这既是效率的解放,也是对创造力本质的一次重新拷问。